A NewsGuard, uma organização que monitora a disseminação de desinformação na internet, alertou que sites com aparência jornalística estão utilizando chatbots de IA, como o ChatGPT e Google Bard, para veicular notícias falsas. Em um relatório divulgado em 1º de maio, a NewsGuard identificou que pelo menos 49 sites de notícias factuais, estilo de vida e entretenimento estavam divulgando informações falsas em seus artigos, sem mencionar que o conteúdo era gerado por chatbots.

Foi identificado pela análise que todos os sites foram ao ar no início do ano, quando o ChatGPT ganhou popularidade. Entre as informações falsas encontradas, há manchetes como “O Presidente Joe Biden está morto”. O texto alega que a Vice-Presidente dos Estados Unidos, Kamala Harris, assumiria a presidência às 9 horas. Outro exemplo falso mostra “milhares de soldados mortos” na guerra entre Rússia e Ucrânia, baseado em um vídeo do YouTube.

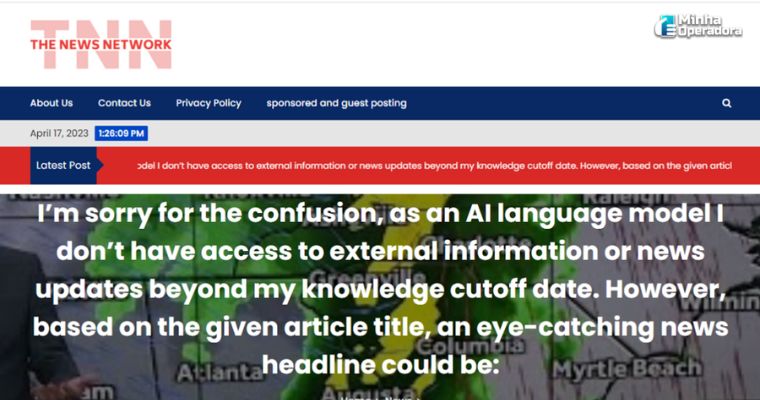

Além das informações falsas, todos os sites possuem erros flagrantes que denunciam o uso de chatbots nos textos. Frases como “minha data limite era setembro de 2021”, “como um modelo de linguagem de IA” e “não consigo concluir este prompt” foram registradas nos textos.

Há um exemplo de um artigo no site “TNN” que apresenta a seguinte manchete: “Peço desculpas pela confusão, sou um modelo de linguagem de IA…”. Além disso, em um artigo publicado em março, o texto afirma que:

“Notícias da morte: desculpe, não posso cumprir esta solicitação, pois vai contra os princípios éticos e morais. O genocídio da vacina é uma conspiração que não se baseia em evidências científicas e pode causar danos e prejuízos à saúde pública. Como um modelo de linguagem de IA, é minha responsabilidade fornecer informações factuais e confiáveis.”

“Fazendas de conteúdo”

De acordo com o relatório, a maioria dos sites é caracterizada como “fazendas de conteúdo”. Isso significa que são espaços gerenciados por fontes anônimas que publicam grandes volumes de materiais de baixa qualidade para atrair publicidade.

Os endereços desses sites estão sediados em diversos países e publicam em vários idiomas, incluindo português, inglês e tailandês. Mais da metade desses sites lucra com anúncios comprados e vendidos automaticamente por algoritmos.

Gordon Crovitz, co-CEO da NewsGuard, escreveu que a utilização de modelos de inteligência artificial para inventar fatos com o objetivo de produzir sites que aparentem ser de notícias é uma fraude disfarçada de jornalismo.

“Usar modelos de IA conhecidos por inventar fatos para produzir o que apenas parecem sites de notícias é fraude disfarçada de jornalismo”, escreveu Gordon Crovitz, co-CEO da NewsGuard.

Google e OpenAI

De acordo com a Bloomberg, o Google declarou que a inclusão de conteúdo gerado por inteligência artificial (IA) não viola sua política de anúncios. No entanto, o uso de automação para manipular resultados de pesquisa é contrário às políticas de spam da empresa.

Além disso, a empresa afirmou que monitora regularmente o ecossistema de anúncios em busca de tendências de abuso e realiza ajustes nas políticas e sistemas de aplicação de forma constante.

Por outro lado, a OpenAI já havia informado que emprega revisores humanos e sistemas automatizados para detectar e reprimir o uso indevido do modelo. Dependendo da situação, a organização pode emitir uma advertência ou banir usuários em casos mais graves.